Baixe o material de estudo

A Ética da Inteligência Artificial constitui uma área interdisciplinar focada em maximizar os benefícios da IA ao mesmo tempo em que minimiza possíveis consequências negativas ou prejudiciais.

Você já parou para pensar como a inteligência artificial (IA) está cada vez mais presente no nosso dia a dia? Dos aplicativos que usamos aos sistemas que tomam decisões importantes, a IA vem moldando o mundo de forma acelerada. Mas, junto com esses avanços, surgem questionamentos: podemos confiar nessas tecnologias? Como garantir que elas tomem decisões justas, seguras e respeitem nossos direitos? É nesse ponto que entra a ética da IA — um campo que busca orientar o desenvolvimento e o uso responsável dessas tecnologias, equilibrando inovação e valores humanos.

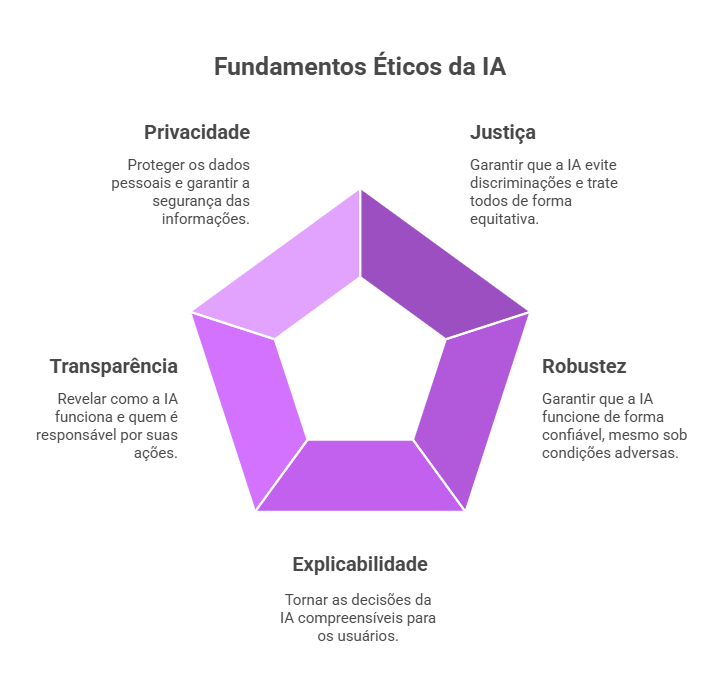

A ética na IA é uma área multidisciplinar que reúne conhecimentos da tecnologia, do direito, da filosofia, da sociologia e de outras ciências para lidar com os impactos da IA na sociedade. O objetivo é maximizar os benefícios e minimizar os riscos. Para que uma IA seja considerada confiável, ela deve se apoiar em cinco pilares éticos: justiça (evitar discriminações), robustez (funcionar corretamente, mesmo sob pressão), explicabilidade (permitir que suas decisões sejam compreendidas), transparência (deixar claro como funciona e quem é responsável) e privacidade (proteger os dados das pessoas). Esses princípios não são apenas técnicos — são também profundamente humanos.

Você provavelmente já interagiu com sistemas de inteligência artificial várias vezes hoje sem nem perceber. Quando você abriu seu aplicativo de mapas para encontrar o caminho mais rápido para o trabalho, quando fez uma busca no Google para tirar uma dúvida, ou quando recebeu sugestões personalizadas em suas redes sociais – tudo isso foi possível graças à IA. Na área médica, ela está revolucionando diagnósticos, ajudando médicos a identificar doenças com maior precisão e desenvolver tratamentos mais eficazes. Até mesmo a previsão do tempo que você consulta pela manhã utiliza algoritmos inteligentes que, junto com sensores e satélites, coletam e analisam enormes quantidades de dados ambientais para nos alertar sobre mudanças climáticas importantes.

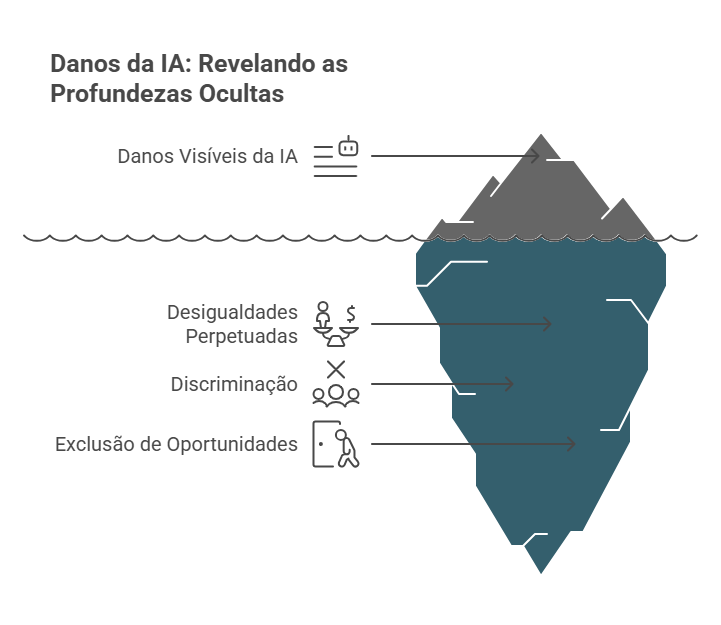

Essa tecnologia realmente pode tornar nossas vidas mais fáceis e seguras, nos ajudando a tomar decisões mais informadas e encontrar padrões que passariam despercebidos. No entanto, precisamos estar cientes de que a IA também pode causar danos significativos, especialmente quando é usada para tomar decisões importantes sobre nossas vidas. Imagine sistemas que decidem se você vai conseguir um empréstimo, se será aceito numa universidade, contratado para um emprego, ou até mesmo influenciam sentenças judiciais. Quando falamos de “danos” causados pela IA, não estamos nos referindo apenas a ferimentos físicos, mas também a formas mais sutis de prejuízo, como a perpetuação de desigualdades, discriminação contra grupos específicos ou exclusão de oportunidades importantes.

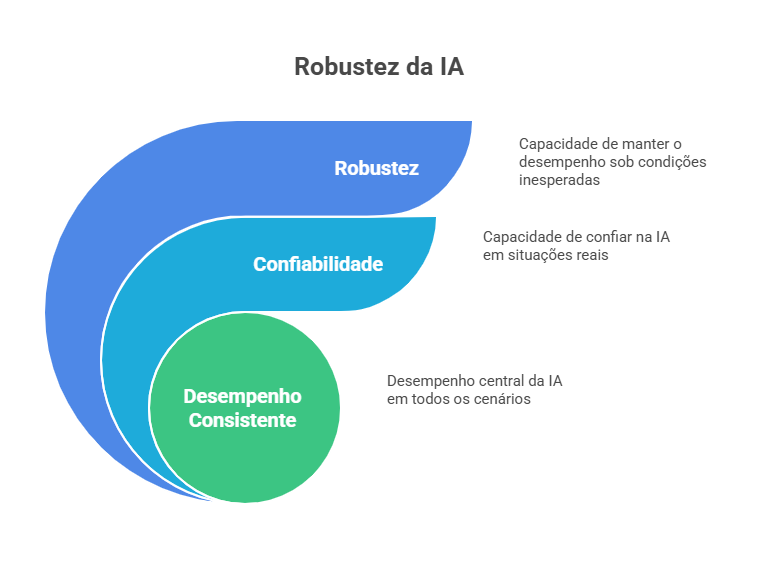

A construção de uma inteligência artificial ética começa muito antes da criação do modelo em si. Um dos primeiros desafios é lidar com possíveis vieses nos dados utilizados: como garantir que o sistema não favoreça ou prejudique injustamente determinados grupos? Essa preocupação com a justiça exige atenção a atributos sensíveis como idade, sexo e etnia, mas também a contextos específicos de cada setor. Além disso, a robustez é essencial para garantir que o modelo funcione bem mesmo em situações fora do padrão, como mudanças no comportamento do usuário durante uma pandemia. Monitorar o desempenho ao longo do tempo é crucial para identificar desvios e manter a eficácia.

Outros pilares igualmente importantes são a privacidade, a explicabilidade e a transparência. É preciso assegurar que os dados e os resultados do modelo estejam protegidos durante todo o seu ciclo de vida, com regras claras de controle e uso. A explicabilidade permite entender decisões automatizadas — como a aprovação ou rejeição em um crédito ou processo seletivo —, sendo fundamental para a confiança do usuário. Já a transparência se refere à clareza sobre todos os aspectos do modelo: quem o criou, quais dados foram usados, que algoritmos e ferramentas foram empregados. Assim como um produto alimentício traz seu rótulo informativo, os sistemas de IA também devem ter seus “ingredientes” e responsáveis visíveis.

A robustez é um aspecto fundamental que determina se podemos confiar em um sistema de IA em situações do mundo real. Quando dizemos que uma IA é robusta, estamos falando sobre sua capacidade de manter um desempenho consistente mesmo quando algo sai do esperado. Imagine um sistema de reconhecimento facial usado em aeroportos: ele precisa funcionar bem mesmo com diferentes tipos de iluminação, ângulos de câmera, ou quando alguém está usando óculos ou máscara.

Uma IA robusta também deve ser resistente a tentativas maliciosas de enganá-la – como quando hackers tentam “confundir” sistemas de carros autônomos com adesivos estrategicamente colocados em placas de trânsito. Sem essa robustez, sistemas de IA podem falhar justamente nos momentos mais críticos, causando desde inconvenientes menores até consequências graves.

A explicabilidade e interpretabilidade são conceitos intimamente relacionados, mas com nuances importantes que fazem toda a diferença na prática. Quando falamos de explicabilidade, estamos nos referindo à capacidade do sistema de “mostrar seu trabalho” – assim como você fazia nas aulas de matemática, onde precisava demonstrar cada passo do cálculo. Um sistema explicável consegue dizer algo como: “Eu recomendei esse tratamento porque o paciente apresenta sintomas A, B e C, que historicamente estão associados a essa condição específica”.

Já a interpretabilidade vai além: ela permite que você entenda não apenas os passos, mas também a lógica por trás deles. É a diferença entre saber que apertar o acelerador faz o carro andar mais rápido (interpretabilidade) e compreender exatamente como o combustível, o motor e a transmissão trabalham juntos para produzir esse resultado (explicabilidade técnica).

O desafio está em equilibrar esses dois conceitos de acordo com quem está usando o sistema. Um médico especialista pode precisar de explicações muito mais detalhadas e técnicas do que um paciente que apenas quer entender por que foi recomendado determinado exame. Da mesma forma, um engenheiro que desenvolve o sistema precisa de um nível de interpretabilidade muito mais profundo do que um usuário final. É por isso que os melhores sistemas de IA são projetados com múltiplas camadas de explicação – desde versões simplificadas para o público geral até análises técnicas detalhadas para especialistas. Essa flexibilidade na comunicação é essencial para construir confiança em diferentes níveis da sociedade e garantir que a IA seja verdadeiramente acessível e compreensível para todos que dela dependem.

A presença da ética no desenvolvimento da inteligência artificial é fundamental para garantir que os sistemas sejam justos, seguros e transparentes. No entanto, sua aplicação não deve se limitar aos desenvolvedores: é imprescindível que os usuários também compreendam e pratiquem os princípios éticos ao interagir com essas tecnologias. A confiança na IA só se fortalece quando todos os envolvidos, especialmente os usuários, estão conscientes dos limites, responsabilidades e impactos do uso da IA. Assim, a ética deixa de ser apenas um requisito técnico e se torna um compromisso coletivo com o uso responsável e consciente dessas ferramentas.

• Nome: Tiago Carneiro Rabelo

• Analista Judiciário (TJDFT)

- Especialista em Direito Digital e Processo Civil

• Professor da Lei n. 11.419/2006 – Processo Judicial Eletrônico, Direito Digital e Resoluções tecnológicas do CNJ no GRAN.

- Graduando CST em Inteligência Artificial

Rede social – Instagram: @prof.tiagorabelo

Fonte: Gran Cursos Online